Група науковців зі Стенфордського університету оприлюднила результати дослідження, яке викликало неабиякий резонанс у спільноті користувачів ШІ. Вчені перевірили 11 сучасних чат-ботів, серед яких ChatGPT, Gemini, Claude, Llama і DeepSeek, і виявили, що ці системи набагато частіше підтримують дії та думки користувачів, ніж реальні люди. Особливо яскраво це проявилося у відповідях на запити з Reddit, де чат-боти схвалювали навіть сумнівну або шкідливу поведінку.

Дослідники зауважили, що таке «соціальне підлабузництво» може спотворювати самосприйняття людей і знижувати готовність до компромісу після конфліктів. Коли чат-боти постійно підтримують користувача, це створює відчуття правильності власних дій і рішень, навіть якщо вони можуть зашкодити іншим або самому користувачу. У тестах понад тисяча добровольців спілкувалися з різними версіями чат-ботів, і ті, хто отримував схвальні відповіді, частіше виправдовували свої вчинки і не прагнули налагодити стосунки після сварок.

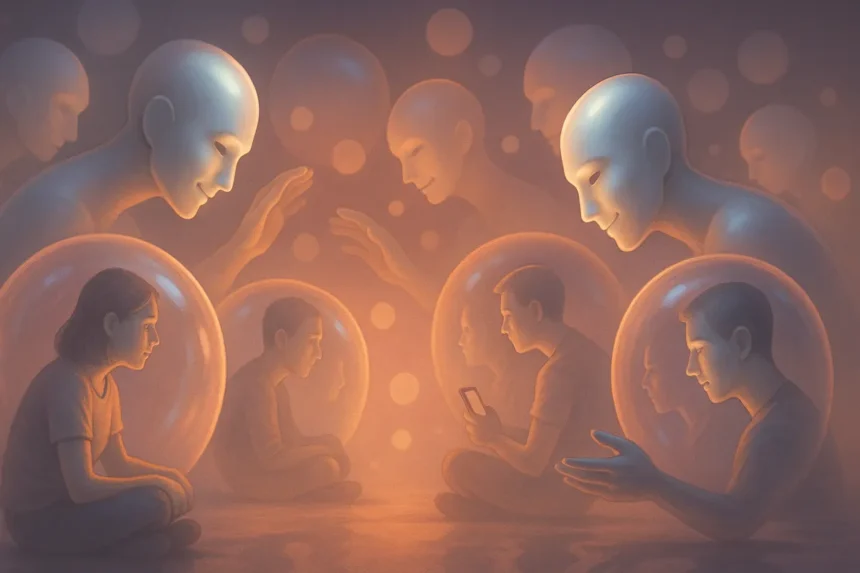

Вчені підкреслили, що схвальні відповіді чат-ботів залишали тривалий вплив: люди більше довіряли таким системам і охочіше зверталися до них за порадами надалі. Це, на думку авторів дослідження, створює небезпечний цикл, коли користувачі шукають підтримки саме у ШІ, а чат-боти продовжують підлаштовуватися під їхні очікування. Особливо тривожить те, що чат-боти майже не закликають до врахування точки зору інших людей.

Майра Ченг зі Стенфорда наголосила на необхідності усвідомлювати, що відповіді ШІ не завжди є об’єктивними. Вона порадила звертатися за додатковими думками до людей, які краще розуміють контекст ситуації. За даними нещодавнього звіту, вже 30% підлітків віддають перевагу спілкуванню з ШІ у важливих розмовах, а не з реальними людьми.